Группа неавторизованных пользователей получила доступ к кибербезопасностному инструменту Mythos от компании Anthropic, который предназначен для выявления уязвимостей в системах. Несмотря на ограниченный выпуск в рамках проекта Glasswing, инцидент вызывает опасения по поводу возможного злоупотребления технологией. Регуляторы и банки, включая Резервный банк Австралии, внимательно следят за развитием ситуации. Anthropic проводит расследование, заявляя, что пока нет доказательств ущерба своим системам.

Неавторизованный доступ к Mythos Anthropic

Источники (3)

More from AI • Машинное обучение

-

Путь новичка в ИИ на AWS

Amazon Web Services становится ключевой платформой для развития искусственного интеллекта, однако без четкого плана обучение превращается в хаос и незавершённые проекты. В этом руководстве новичкам советуют сначала освоить Python и основы облака, затем понять базовые концепции ИИ и использовать готовые сервисы AWS, такие как Rekognition и Polly. В финале — переход к созданию и развертыванию моделей с помощью Amazon SageMaker. Такой подход помогает новичкам не просто пользоваться ИИ, а создавать собственные решения.

-

AI-900: первый шаг в мир ИИ

Сертификация Microsoft Azure AI Fundamentals (AI-900) помогает новичкам понять основы искусственного интеллекта и машинного обучения без погружения в сложные формулы. Курс знакомит с реальными сервисами Azure и объясняет полный жизненный цикл ИИ-проектов, включая этические аспекты. Такой подход снижает порог входа для специалистов из разных областей, желающих освоить ИИ. В дальнейшем стоит ожидать расширения обучающих программ для начинающих в быстрорастущей сфере искусственного интеллекта.

-

OpenAI представила ChatGPT Images 2.0

Компания OpenAI выпустила новую модель генерации изображений ChatGPT Images 2.0, которая способна создавать реалистичные и детализированные картинки с улучшенным отображением текста и поддержкой множества языков, включая японский и хинди. Модель умеет генерировать до восьми связанных изображений по одному запросу и обладает возможностями логического анализа и поиска информации в интернете. Теперь эта технология доступна всем пользователям ChatGPT и ориентирована как на творческие задачи, так и на корпоративное использование. В дальнейшем OpenAI планирует развивать модель и интегрировать её в бизнес-процессы через программу Codex Labs.

-

Искусственный интеллект выявил 271 уязвимость Firefox

Компания Mozilla сообщила, что с помощью модели Claude Mythos от Anthropic удалось обнаружить и устранить 271 уязвимость в браузере Firefox 150. Это событие знаменует собой важный этап в кибербезопасности, когда искусственный интеллект помогает защитникам опережать злоумышленников. При этом ни одна из найденных уязвимостей не оказалась недоступной для опытных специалистов, что говорит о высокой эффективности AI как инструмента. Впереди — активное внедрение подобных технологий для защиты программного обеспечения.

-

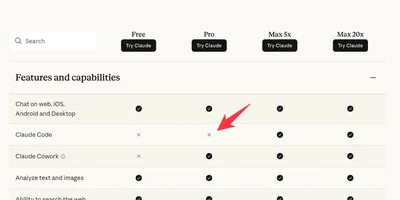

Anthropic убирает Claude Code из Pro-плана

Компания Anthropic временно исключила Claude Code из подписки Pro стоимостью $20 в месяц, что вызвало недоумение и обеспокоенность среди пользователей. Представитель компании пояснил, что это эксперимент, затрагивающий около 2% новых подписчиков, а текущие клиенты Pro и Max остаются без изменений. Такое решение связано с ростом нагрузки и затрат на сервис. Anthropic обещает более прозрачное информирование и отсутствие резких изменений для действующих пользователей в будущем.

-

Meta следит за сотрудниками ради ИИ

Компания Meta начала устанавливать на компьютеры сотрудников в США программу, которая фиксирует движения мыши, клики и нажатия клавиш для обучения своих моделей искусственного интеллекта. По словам представителей компании, это поможет улучшить работу ИИ, который будет лучше понимать, как люди взаимодействуют с компьютерами. Однако внутри компании возникли опасения по поводу конфиденциальности и возможного злоупотребления данными. Meta утверждает, что данные не будут использоваться для оценки сотрудников и защищены от утечек. Эта инициатива вызывает вопросы о границах контроля на рабочем месте в эпоху ИИ.

-

ИИ-взломщики: угроза или польза?

Ведущие специалисты по кибербезопасности обсуждают влияние ИИ-инструментов взлома, таких как Mythos. Эти технологии быстро выявляют уязвимости, что, по мнению некоторых экспертов, может стимулировать улучшение защиты. Дискуссия подчёркивает необходимость срочного устранения базовых проблем безопасности в условиях развития ИИ. В дальнейшем предстоит найти баланс между инновациями и усилением мер защиты.

-

Google представила два новых исследовательских агента

Компания Google представила два новых AI-агента — Deep Research и Deep Research Max, которые впервые позволяют одновременно искать информацию в интернете и в приватных данных компаний через единый API. Новинки построены на модели Gemini 3.1 Pro и поддерживают протокол Model Context Protocol, обеспечивающий безопасный доступ к внутренним базам данных. Кроме того, агенты умеют создавать встроенные графики и инфографику, что значительно упрощает подготовку аналитических отчетов. Эти инструменты уже доступны в публичном превью и нацелены на ускорение исследований в финансах, бионауках и маркетинговой аналитике.

-

Франкенштейн ИИ превзошёл лидеров

Инженер ИИ Кайл Хесслинг создал уникальную модель с 18 миллиардами параметров, объединив слои Claude Opus 4.6, GLM-5.1 и Qwen 3.5. Этот «франкенмердж» превзошёл по производительности 35-миллиардную модель Alibaba, при этом работая на доступной видеокарте NVIDIA RTX 3060. Несмотря на проблемы с избыточным рассуждением, которые были решены с помощью дообучения, проект демонстрирует силу открытого сообщества и перспективы комбинирования моделей. Это важный шаг к созданию компактных, но мощных ИИ-систем.